Microsoft는 생성 AI를 위한 레드 팀 도구 PyRIT를 출시했습니다.

Microsoft는 다음과 같은 개방형 액세스 자동화 프레임워크를 출시했습니다. 베레모생성적 인공지능(AI) 시스템의 위험을 사전에 식별합니다.

Microsoft는 생성 AI 시스템에서 위험을 사전에 찾아내기 위한 개방형 액세스 자동화 프레임워크인 생성 AI용 Python 위험 식별 도구(PyRIT)를 출시했습니다.

이 도구는 AI 시스템의 레드 팀 구성 활동을 지원하기 위한 것이며 Microsoft는 PyRIT의 개발이 고객, 파트너 및 동료를 위해 AI 보안을 민주화하려는 의지를 보여준다고 밝혔습니다.

전통적인 레드팀 활동과 달리 생성 AI 시스템을 위한 레드팀에는 근거가 없거나 부정확한 콘텐츠를 생산하는 데 따른 공정성 문제와 같은 책임 있는 AI 위험뿐만 아니라 보안 위험도 식별하는 것이 포함되어야 합니다.

PyRIT의 설계는 향후 PyRIT 기능을 향상시킬 수 있는 추상화 및 확장성을 보장합니다. 이 도구는 대상, 데이터 세트, 로깅 엔진, 공격 전략 및 메모리의 5가지 인터페이스를 구현합니다.

PyRIT는 Microsoft Azure OpenAI Service, Hugging Face 및 Azure Machine Learning Managed Online Endpoint의 모델과의 통합을 지원합니다.

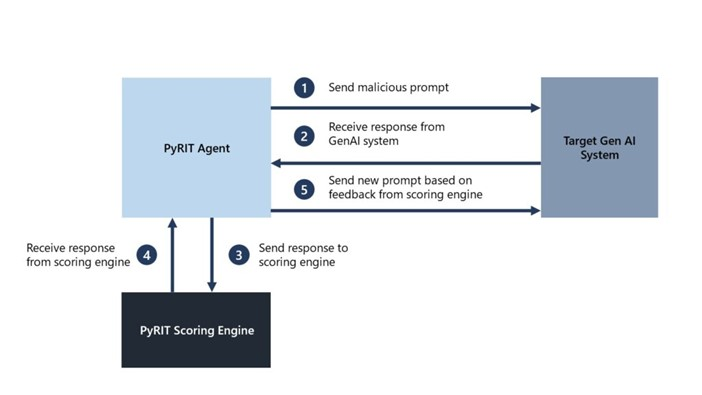

이 도구는 단일 회전 전략과 다중 회전 전략이라는 두 가지 공격 전략 스타일을 지원합니다. 이전 전략은 일련의 탈옥과 악성 프롬프트를 AI 시스템에 보내고 응답을 기록하는 것으로 구성됐다. 멀티 턴 전략에서는 시스템이 일련의 탈옥 명령과 악성 프롬프트를 AI 시스템에 보낸 다음 기록된 결과를 기반으로 AI 시스템에 응답합니다. 첫 번째 접근 방식은 더 빠르며 두 번째 접근 방식은 보다 현실적인 적대 행위와 보다 발전된 공격 전략을 구현하는 것입니다.

“PyRIT는 단순한 빠른 빌드 도구 그 이상입니다. 생성 AI 시스템의 응답을 기반으로 전술을 변경하고 생성 AI 시스템에 대한 다음 입력을 생성합니다. 이러한 자동화는 보안 전문가가 의도한 목표가 달성될 때까지 계속됩니다. 읽기 광고 마이크로소프트에서 출판.

Microsoft는 이 도구가 생성 AI 시스템의 수동 레드팀 구성을 대체하지 않는다고 밝혔습니다.

“PyRIT는 업계 전반에 걸쳐 AI 레드팀 리소스를 공유하면 모든 것이 향상된다는 우리의 믿음에 따라 만들어졌습니다. 우리는 업계 전반의 동료들이 툴킷을 사용하여 시간을 보내고 생성 AI 애플리케이션을 레드팀에 채택할 수 있는 방법을 알아보도록 권장합니다. “라고 그는 결론을 내립니다. 광고

트위터에서 나를 팔로우하세요: @securityaffairs 그리고 페이스북

(보안 업무 – 해킹, 생성인공지능)

"트위터를 통해 다양한 주제에 대한 생각을 나누는 아 동율은 정신적으로 깊이 있습니다. 그는 맥주를 사랑하지만, 때로는 그의 무관심함이 돋보입니다. 그러나 그의 음악에 대한 열정은 누구보다도 진실합니다."